Por qué la IA necesita una mejor privacidad

La Inteligencia Artificial avanza muy rápido. Pero muchas personas y organizaciones aún no pueden utilizar sus datos más valiosos con la IA. Para usar la mayoría de las herramientas de IA hoy en día, debes enviar tu texto, documentos o registros a computadoras que no posees y no puedes inspeccionar. Tienes que confiar en las políticas de la empresa, los contratos legales y las promesas de marketing. Estas formas de confianza aún pueden fallar.

Entonces la gran pregunta es: ¿cómo podemos desbloquear todo el poder de la IA, sin renunciar a la privacidad y el control sobre nuestros datos?

El enfoque de IA de NEAR: Privacidad que puedes verificar

NEAR AI fue creado para cerrar esta “brecha de privacidad de la IA”. Sus productos se basan en dos ideas principales: privacidad verificable y IA propiedad del usuario.

Privacidad verificable significa que no solo confías en lo que dice una empresa. En cambio, puedes verificar pruebas criptográficas de que tus datos se mantuvieron privados y seguros durante todo el proceso de IA. IA propiedad del usuario significa que mantienes el control sobre cómo se utilizan tus datos y modelos de IA.

Este diseño sigue la visión del Protocolo NEAR de que las personas deberían ser dueñas realmente de su IA y llevar de forma segura datos importantes a los sistemas de IA.

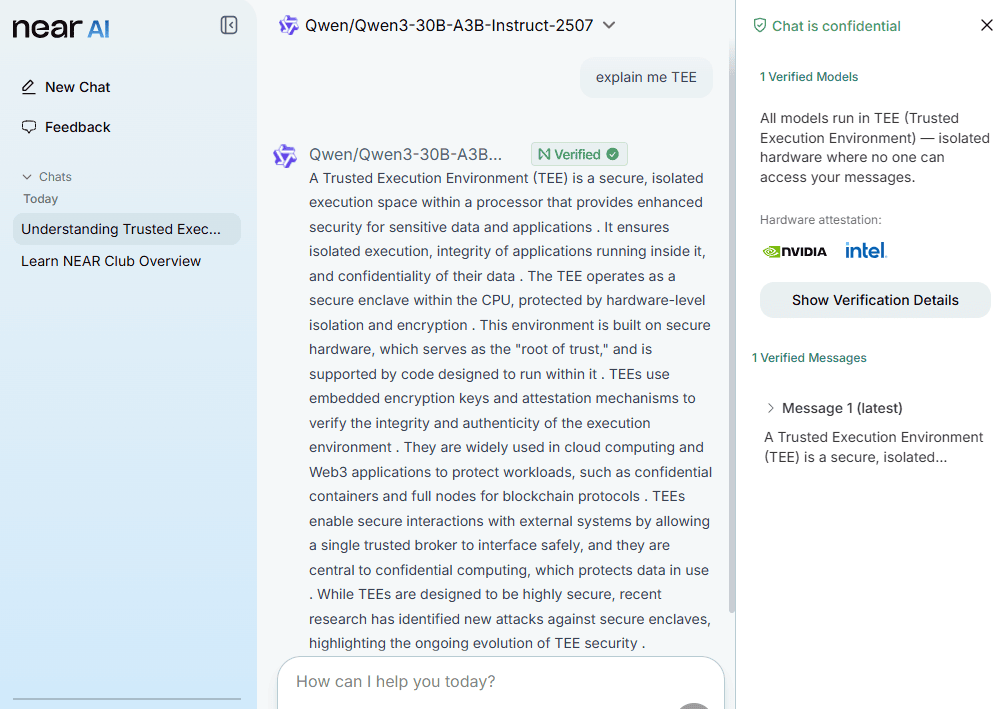

Entornos de Ejecución Confiables: Un “Cofre” para tus Datos

La tecnología central detrás de NEAR AI es un tipo especial de área de hardware llamada Entorno de Ejecución Confiable (TEE). NEAR AI utiliza TEEs de empresas como Intel y NVIDIA como parte de sus herramientas de computación confidencial.

Puedes imaginar un TEE como un cofre cerrado y sellado dentro del procesador de una computadora. Los datos entran en este cofre, son utilizados por un modelo de IA, y luego salen de nuevo, pero nadie fuera del cofre puede ver lo que sucede dentro. Ni el proveedor de la nube, ni el operador del servidor, ni siquiera NEAR AI.

Así es como funciona una interacción de IA privada con NEAR AI:

-

Encriptar: Su indicación o datos se encriptan en su dispositivo antes de ser enviados a una máquina virtual segura dentro del TEE.

-

Aislar: Dentro de este “enclave” protegido, el modelo de IA desencripta sus datos, ejecuta la inferencia (el proceso de generar una respuesta) y luego vuelve a encriptar el resultado.

-

Verificar: Usted desencripta la respuesta localmente. También recibe una prueba criptográfica que muestra que la computación se realizó en hardware genuino y no modificado utilizando el código esperado.

Esto proporciona privacidad de extremo a extremo que usted puede verificar de forma independiente, en lugar de simplemente creer en una promesa.

Dos Productos: NEAR AI Cloud y NEAR Private Chat

NEAR AI utiliza esta tecnología en dos productos diferentes, cada uno para un público y caso de uso diferente:

-

NEAR AI Cloud está diseñado para desarrolladores, empresas y gobiernos.

-

NEAR Private Chat está diseñado para usuarios cotidianos.

|

Característica

|

NEAR AI Cloud

|

NEAR Private Chat

|

|

Público Principal

|

Desarrolladores, Empresas y Gobierno

|

Usuarios cotidianos

|

|

Propósito Principal

|

Desplegar inferencia de IA privada para cargas de trabajo sensibles y datos propietarios

|

Tener conversaciones de IA privadas y cotidianas con la tranquilidad que mereces

|

|

Cómo Usar

|

A través de una API compatible con OpenAI que se integra directamente en aplicaciones y servicios

|

A través de una interfaz de chat familiar y fácil de usar

|

Ambos productos están construidos sobre la misma base de privacidad en primer lugar, pero ofrecen diferentes formas de interactuar con la IA.

NEAR AI Cloud: IA Privada para Cargas de Trabajo Sensibles

NEAR AI Cloud es una plataforma para ejecutar IA que maneja datos sensibles o regulados, como información de clientes o lógica empresarial propietaria.

Sus principales beneficios son:

-

Implementación rápida y privada: Los desarrolladores pueden agregar inteligencia artificial privada a sus aplicaciones en minutos, utilizando una sola API compatible con herramientas existentes al estilo de OpenAI.

-

Protección de datos y propiedad intelectual integrada: Cada solicitud se ejecuta dentro de un TEE. Esto protege los datos personales y la propiedad intelectual por diseño y reduce la necesidad de gestionar muchas herramientas de seguridad separadas.

-

Flexibilidad sin bloqueo: Los equipos pueden cambiar entre diferentes modelos de IA o escalar su uso hacia arriba y hacia abajo sin cambiar su código.

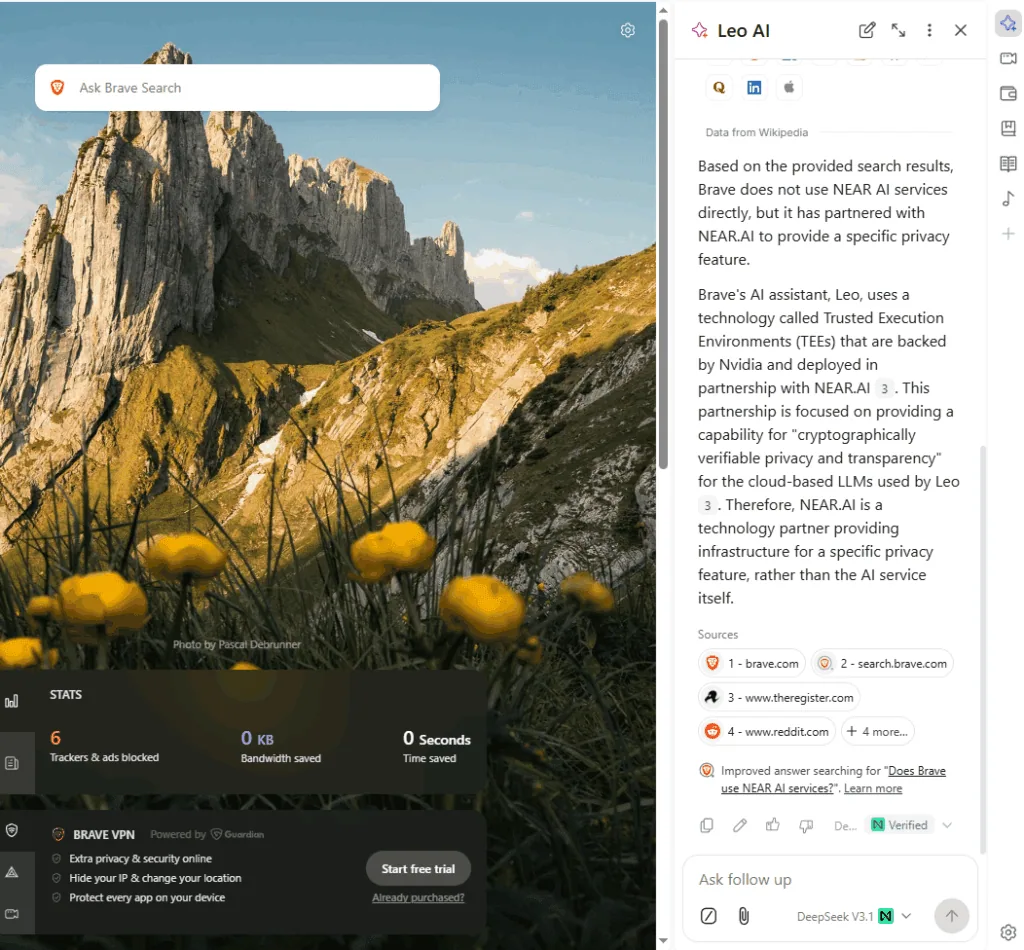

NEAR AI Cloud ya está siendo utilizado en producción por socios como Brave Nightly, OpenMind, Phala y Learn NEAR Club para aplicaciones críticas de privacidad.

Chat Privado de NEAR: Conversaciones Diarias, Mantenidas Privadas

NEAR Private Chat ofrece las mismas garantías de privacidad sólidas a las conversaciones diarias normales de IA. Puedes preguntar sobre dinero, salud, trabajo o relaciones sabiendo que tus datos no se utilizan para entrenar modelos, no se minan para anuncios y no son visibles para los proveedores.

Su modelo de privacidad se basa en cuatro principios simples:

-

Privado: Los modelos de IA se ejecutan dentro de TEEs.

-

Seguro: Los datos dentro de un TEE no pueden ser leídos por el sistema host u otras aplicaciones.

-

Verificable: Los usuarios pueden verificar pruebas criptográficas de que el hardware y el código son genuinos e intocados.

-

Tuyos: Tus datos son tuyos. No son visibles para los proveedores de modelos, proveedores de la nube o NEAR.

Comenzando con NEAR AI

Si eres un desarrollador:

-

Explora la documentación completa en docs.near.ai.

-

Revisa el código y ejemplos en GitHub en github.com/nearai.

Si eres un usuario habitual:

-

Prueba NEAR Private Chat en private.near.ai/welcome y experimenta la privacidad verificable en la práctica.

Conclusión

NEAR AI muestra que no tenemos que elegir entre una IA potente y una privacidad sólida. Al combinar criptografía, hardware seguro y un diseño claro, hace posible utilizar datos sensibles con IA manteniendo el control en manos de usuarios y organizaciones. La privacidad verificable convierte el “confía en nosotros” en “compruébalo por ti mismo” y abre la puerta a un uso más seguro y confiado de la IA en todas partes.

Preguntas reflexivas

-

Cuando utilizas herramientas de IA hoy en día, ¿qué tipos de datos evitas compartir actualmente y por qué?

-

¿Cómo podría cambiar la privacidad verificable la forma en que tu escuela, lugar de trabajo o negocio utiliza la IA?

-

En tus propias palabras, ¿cómo explicarías un Entorno de Ejecución Confiable a un amigo?

Updated: diciembre 3, 2025