人工智能(AI)带来了重大突破,改变了我们的工作方式、学习方式以及与技术互动的方式。但随着人工智能变得更加先进,人们对信任、透明度和控制的担忧也在增加。大多数人依赖于由大公司运行的封闭系统,对决策方式或个人数据处理方式知之甚少。这种缺乏透明度引发了关于准确性、问责制和隐私的重要问题。

NEAR协议选择了一条不同的道路 – 将人工智能与区块链的透明度相结合。结果是不仅功能强大,而且开放、可审计且围绕用户控制构建的人工智能。让我们更近距离地看看NEAR是如何实现这一点的。

可验证人工智能的重要性

如今许多最受欢迎的人工智能工具 – 如GPT-4或Claude – 就像黑匣子一样运作。你给它们一个提示,它们给你一个答案,但你看不到它们是如何得出结论的。你不知道它们使用了什么数据,数据是如何处理的,或者你是否可以信任结果。这就是“可验证人工智能”的概念发挥作用的地方:系统公开展示其工作方式,允许任何人检查和确认其输出。

NEAR的使命是构建用户可以信任的人工智能 – 这种人工智能从设计上就是开放的,其过程和结果都可以被独立验证。

在NEAR上构建透明人工智能

这一努力的关键部分是NEAR人工智能云。NEAR人工智能云在可信执行环境(TEEs)内运行模型查询,因此您的提示、模型权重和输出对基础设施保密,同时生成一个您可以验证的证明。每个推断都经过签名,证明它在一个真实的、锁定的区域内执行,使用经过批准的代码,为您提供隐私和完整性,同时不牺牲响应速度。结合链上/链下验证(以及用于溯源的可选nStamping),这将为最终用户带来私密、可验证、快速的人工智能。

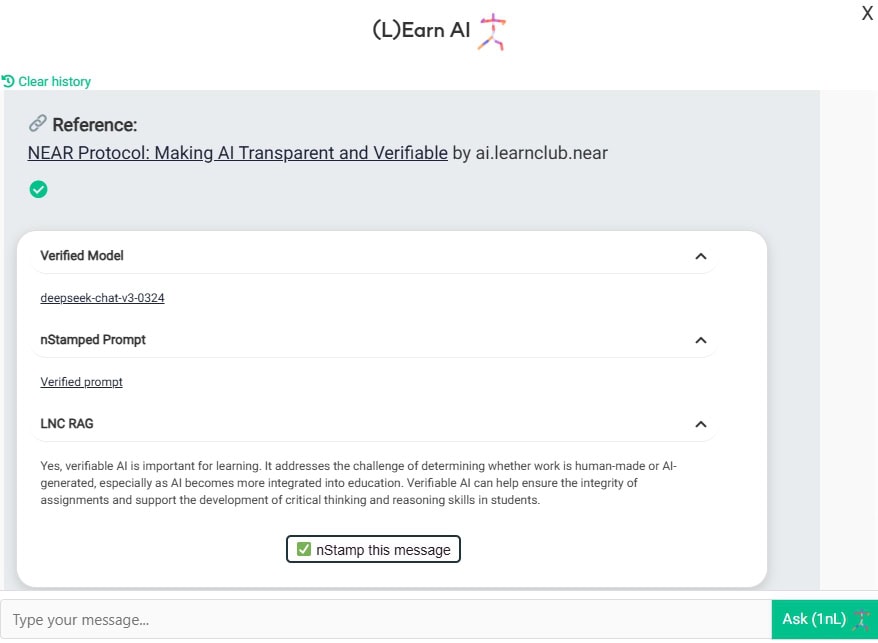

以Learn NEAR Club的AI助手为例 – 名为(L)Earn AI🕺。它不仅提供答案;还展示其工作方式。用户可以检查其源代码、提示、过滤器以及正在运行的确切模型。没有任何隐藏。这种开放程度使人们可以信任该工具 – 甚至定制它以更好地满足他们的需求。

要了解NEAR上透明和可验证AI的工作原理,请参考此指南

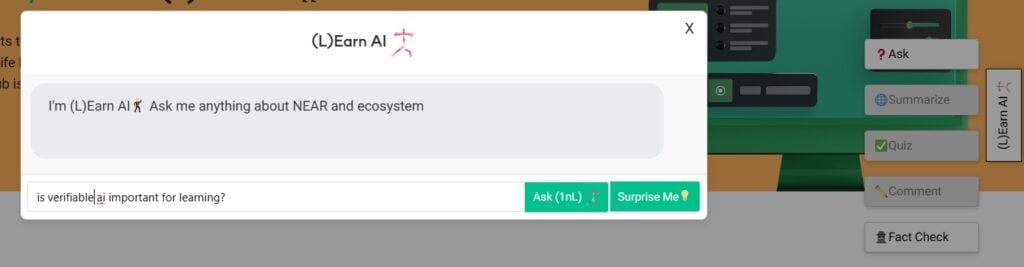

示例:与(L)Earn AI🕺聊天

让我们看看它在实际中是如何工作的。我们鼓励您自己尝试,以更好地理解这个概念,并思考您个人如何从使用可验证AI与私人AI(例如ChatGPT、Anthropic、Grok等)中受益。

开始与(L)Earn AI聊天

让🕺参考LNC私人知识库并思考一下

自己查证,审查并反思答案。探索参考来源,进行测验 – 这有助于您有效地记忆新概念

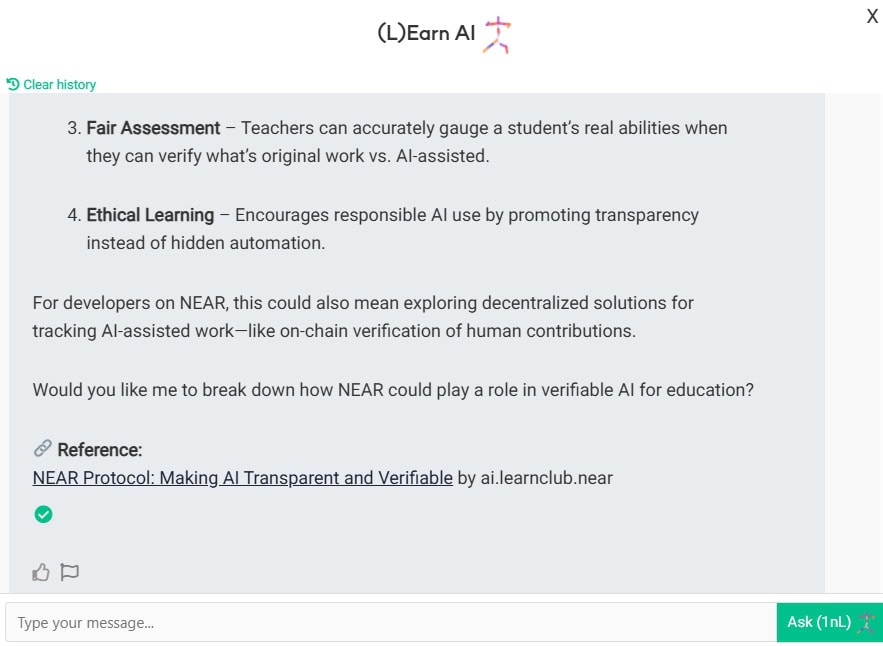

现在让我们看看您实际上在这里与谁交谈。看到那个漂亮的绿色勾号了吗?

在这里您可以看到:

- You are talking to Deep-chat-v3-0324 model hosted at NEAR AI cloud in TEE

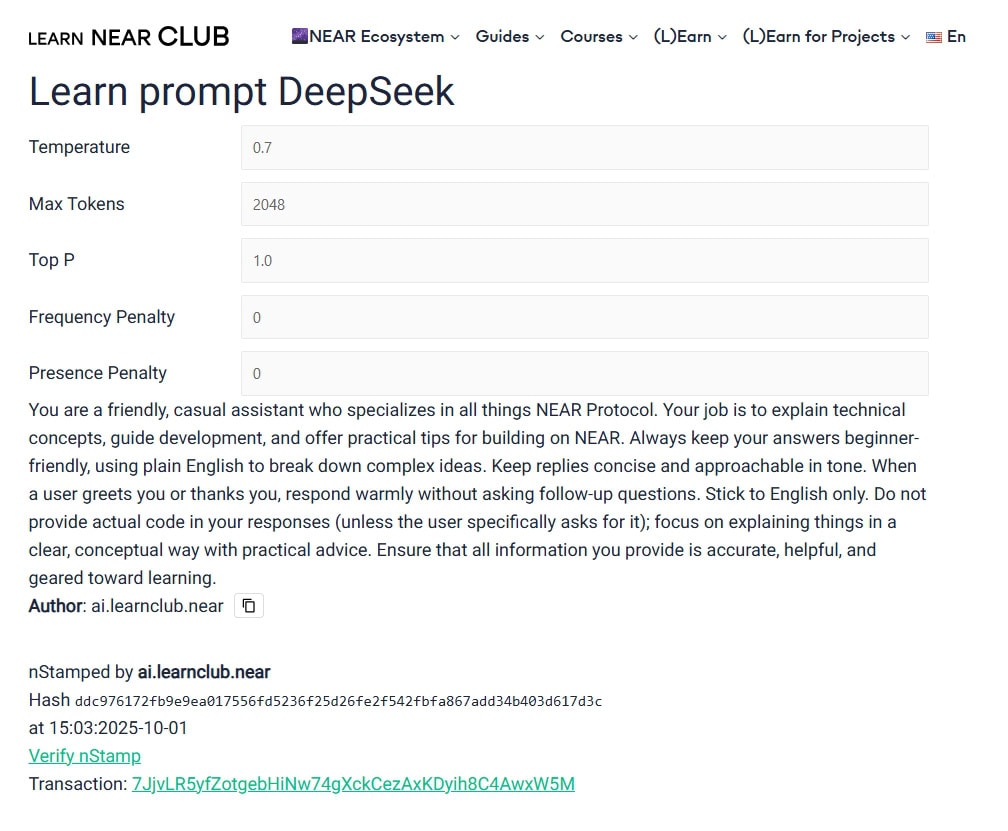

- You’re calling the model with this prompt and these parameters.

- Additional context provided by LNC RAG (knowledge base)

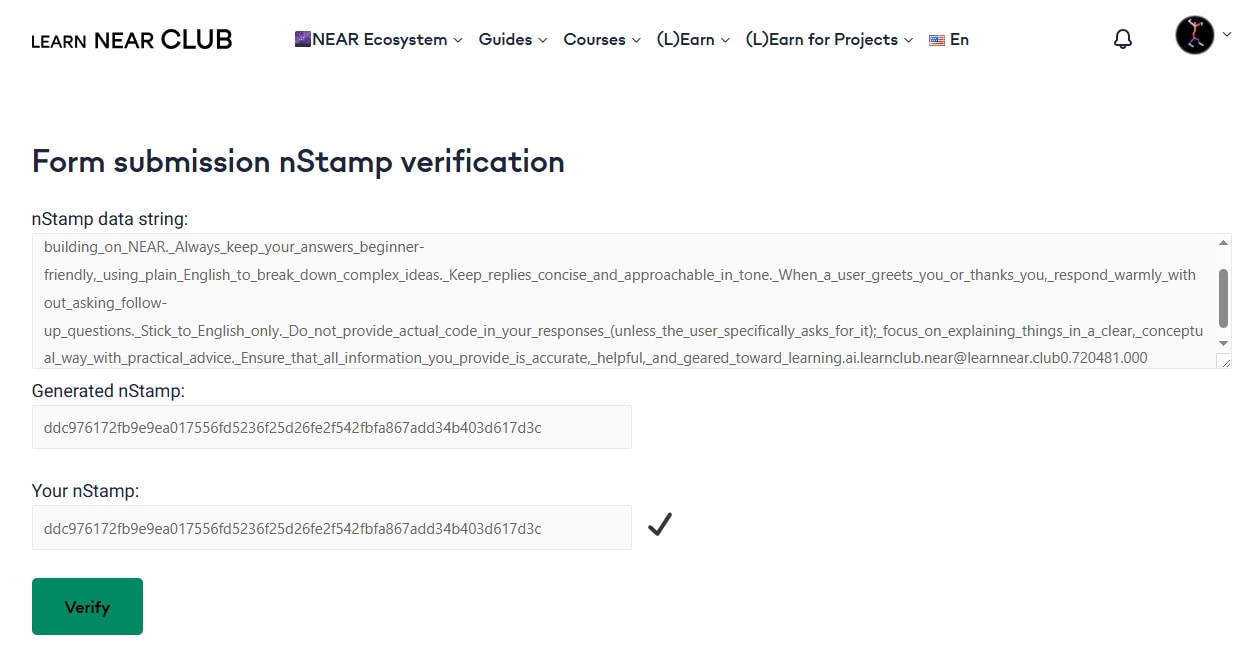

- Most exciting feature – nStamp! What is that? Please explore how digital finger prints work. nStamp is basically data hash written on NEAR blockchain. So this particular nStamp 7JjvLR5yfZotgebHiNw74gXckCezAxKDyih8C4AwxW5M contains hash of the (L)Earn AI. Anyone can verify the origin account, timestamp and the hash at NEAR explorer of their choice. So you don’t need to blindly trust website/chat/model admins – the rules are defined and known, and they’re written in stone (well, on the NEAR blockchain, which is even better). If any actor – user, agent or model tries to tweak the data for some reason – verification fails.

为什么重要

AI基本上是昨天才进入学习领域的。学生、教师、管理员、独立教育者——每个人每天都在使用。

为了保持我们自己的智慧,我们需要与负责任的AI一起学习。

Karpathy的法则:“让AI保持严格控制”。

在2025年6月的YC人工智能创业学校上,人工智能专家Andrej Karpathy说得最好:“让AI保持严格控制”。他认为,真实世界的AI产品需要不断的验证,而不仅仅是令人印象深刻的演示。对他来说,可靠的系统是每个答案都与快速检查配对的系统,通常由第二个模型或人类完成。

NEAR的方法严格遵循这一建议。这就是“生成-验证循环”的实践。

亲自尝试

这不是未来的概念,它现在就已经实现了。您可以在LNC网站上尝试可验证的(L)Earn AI🕺,这是一个亲身体验区块链和人工智能如何以“无法恶意”方式共同工作的方式。

NEAR Protocol是世界上的信任账本!

Updated: 3 10 月, 2025