Por que a IA precisa de uma melhor privacidade

A Inteligência Artificial está avançando muito rápido. Mas muitas pessoas e organizações ainda não conseguem usar seus dados mais valiosos com a IA. Para usar a maioria das ferramentas de IA hoje, você precisa enviar seu texto, documentos ou registros para computadores que você não possui e não pode inspecionar. Você precisa confiar nas políticas da empresa, contratos legais e promessas de marketing. Essas formas de confiança ainda podem falhar.

Então a grande questão é: como podemos desbloquear todo o poder da IA, sem abrir mão da privacidade e do controle sobre nossos dados?

A abordagem de IA da NEAR: Privacidade que você pode verificar

NEAR AI foi criada para fechar essa “lacuna de privacidade da IA”. Seus produtos são construídos com base em duas ideias principais: privacidade verificável e IA de propriedade do usuário.

Privacidade verificável significa que você não confia apenas no que uma empresa diz. Em vez disso, você pode verificar prova criptográfica de que seus dados permaneceram privados e seguros durante todo o processo de IA. IA de propriedade do usuário significa que você mantém o controle sobre como seus dados e modelos de IA são usados.

Este design segue a visão do Protocolo NEAR de que as pessoas devem realmente ser proprietárias de sua IA e trazer com segurança dados importantes para os sistemas de IA.

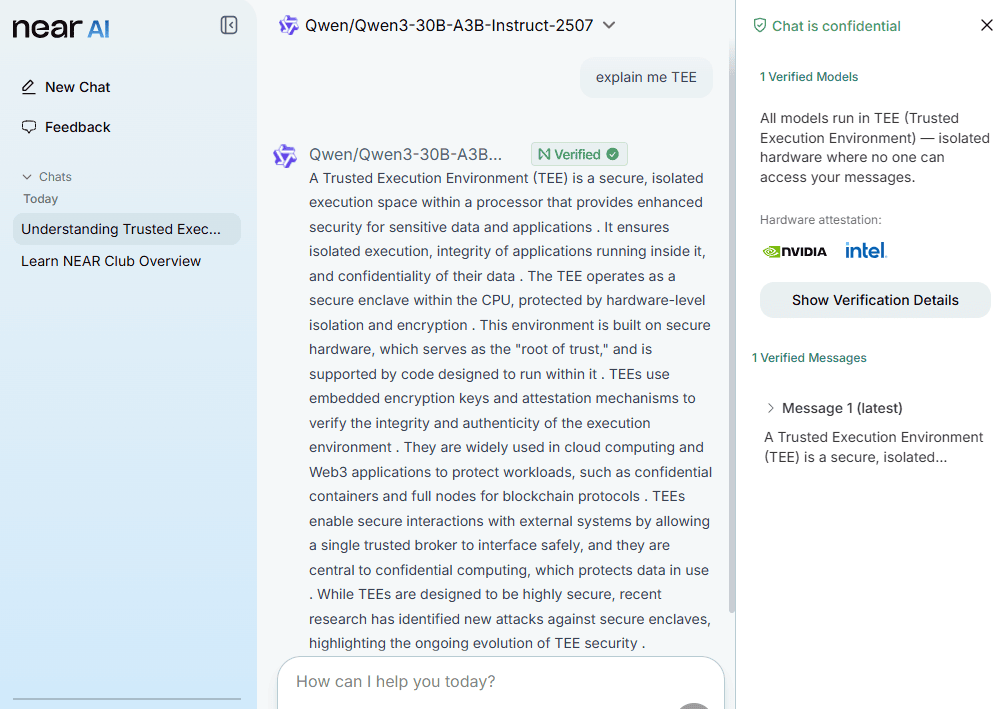

Ambientes de Execução Confiável: Um “Cofre” para seus Dados

A tecnologia central por trás da NEAR AI é um tipo especial de área de hardware chamada Ambiente de Execução Confiável (TEE). A NEAR AI utiliza TEEs de empresas como Intel e NVIDIA como parte de suas ferramentas de computação confidencial.

Você pode imaginar um TEE como um cofre trancado e selado dentro do processador de um computador. Os dados entram neste cofre, são usados por um modelo de IA e depois saem novamente, mas ninguém fora do cofre pode ver o que acontece dentro. Nem o provedor de nuvem, nem o operador do servidor, e nem mesmo a NEAR AI.

Veja como funciona uma interação de IA privada com a NEAR AI:

-

Criptografar: Seu prompt ou dados são criptografados em seu dispositivo antes de serem enviados para uma máquina virtual segura dentro do TEE.

-

Isolar: Dentro deste “enclave” protegido, o modelo de IA descriptografa seus dados, executa a inferência (o processo de gerar uma resposta) e então recriptografa o resultado.

-

Verificar: Você descriptografa a resposta localmente. Você também recebe uma prova criptográfica mostrando que a computação foi feita em hardware genuíno e não modificado usando o código esperado.

Isso proporciona privacidade de ponta a ponta que você pode verificar de forma independente, em vez de apenas acreditar em uma promessa.

Dois Produtos: NEAR AI Cloud e NEAR Private Chat

NEAR AI usa essa tecnologia em dois produtos diferentes, cada um para um público e caso de uso diferentes:

-

NEAR AI Cloud é projetado para desenvolvedores, empresas e governos.

-

NEAR Private Chat é projetado para usuários comuns.

|

Recurso

|

NEAR AI Cloud

|

NEAR Private Chat

|

|

Público Principal

|

Desenvolvedores, Empresas e Governo

|

Usuários do dia a dia

|

|

Propósito Principal

|

Implantar inferência de IA privada para cargas de trabalho sensíveis e dados proprietários

|

Ter conversas de IA privadas e cotidianas com a tranquilidade que você merece

|

|

Como Usar

|

Através de uma API compatível com OpenAI que se integra diretamente em aplicativos e serviços

|

Através de uma interface de chat familiar e fácil de usar

|

Ambos os produtos são construídos sobre a mesma base de privacidade em primeiro lugar, mas oferecem maneiras diferentes de interagir com a IA.

NEAR AI Cloud: IA Privada para Cargas de Trabalho Sensíveis

NEAR AI Cloud é uma plataforma para executar IA que lida com dados sensíveis ou regulamentados, como informações de clientes ou lógica de negócios proprietária.

Seus principais benefícios são:

-

Implantação privada rápida: Os desenvolvedores podem adicionar IA privada aos seus aplicativos em minutos, usando uma única API compatível com ferramentas existentes no estilo OpenAI.

-

Proteção de dados e PI integrada: Cada solicitação é executada dentro de um TEE. Isso protege os dados pessoais e a propriedade intelectual por design e reduz a necessidade de gerenciar muitas ferramentas de segurança separadas.

-

Flexibilidade sem lock-in: As equipes podem alternar entre diferentes modelos de IA ou dimensionar seu uso para cima e para baixo sem alterar seu código.

NEAR AI Cloud já está sendo usado em produção por parceiros como Brave Nightly, OpenMind, Phala e Learn NEAR Club para aplicações críticas de privacidade.

NEAR Private Chat: Conversas do Dia a Dia, Mantidas Privadas

O NEAR Private Chat traz as mesmas garantias de privacidade forte para conversas diárias normais de IA. Você pode perguntar sobre dinheiro, saúde, trabalho ou relacionamentos, sabendo que seus dados não são usados para treinar modelos, não são minerados para anúncios e não são visíveis para os provedores.

Seu modelo de privacidade é baseado em quatro princípios simples:

-

Privado: Os modelos de IA são executados dentro de TEEs.

-

Seguro: Os dados dentro de um TEE não podem ser lidos pelo sistema hospedeiro ou outros aplicativos.

-

Verificável: Os usuários podem verificar provas criptográficas de que o hardware e o código são genuínos e não foram adulterados.

-

Seus: Seus dados permanecem seus. Eles não são visíveis para os provedores de modelos, provedores de nuvem ou NEAR.

Começando com o NEAR AI

Se você é um desenvolvedor:

-

Explore a documentação completa em docs.near.ai.

-

Revise o código e exemplos no GitHub em github.com/nearai.

Se você é um usuário comum:

-

Experimente o NEAR Private Chat em private.near.ai/welcome e experimente a privacidade verificável na prática.

Conclusão

NEAR AI mostra que não precisamos escolher entre IA poderosa e privacidade forte. Ao combinar criptografia, hardware seguro e design claro, torna possível usar dados sensíveis com IA mantendo o controle nas mãos dos usuários e organizações. A privacidade verificável transforma o “confie em nós” em “verifique por si mesmo” e abre as portas para um uso mais seguro e confiante da IA em todos os lugares.

Perguntas reflexivas

-

Quando você usa ferramentas de IA hoje, que tipos de dados você evita compartilhar e por quê?

-

Como a privacidade verificável poderia mudar a forma como sua escola, local de trabalho ou empresa utiliza a IA?

-

Em suas próprias palavras, como você explicaria um Ambiente de Execução Confiável para um amigo?

Updated: Dezembro 3, 2025